在高并发 Web 应用架构中,缓存是提升系统响应速度、降低后端服务压力的核心手段。Nginx 作为一款高性能的 HTTP 服务器和反向代理,其内置的缓存模块(

proxy_cache)能够有效实现静态资源、接口数据的缓存管理。但缓存并非简单开启即可,缓存命中失效的处理与过期时间(TTL)的精准配置,直接决定了缓存的实际效果与数据的一致性。本文将结合实际业务场景,详细讲解 Nginx 缓存策略的优化思路,重点分析缓存命中失效的场景、过期时间配置原则及实战配置方案,帮助开发者构建高效、稳定的 Nginx 缓存体系。

一、Nginx 缓存核心基础

在深入优化之前,先回顾 Nginx 缓存的核心配置与工作原理,为后续内容铺垫基础。

1.1 核心配置指令

Nginx 缓存的核心依赖

ngx_http_proxy_module模块,核心指令如下:表格

| 指令 | 作用 | 配置示例 |

|---|---|---|

proxy_cache_path |

定义缓存存储路径、缓存名称、最大容量等 | proxy_cache_path /var/nginx/cache levels=1:2 keys_zone=my_cache:10m max_size=10g inactive=60m use_temp_path=off; |

proxy_cache |

开启缓存并指定缓存名称 | proxy_cache my_cache; |

proxy_cache_key |

定义缓存键(默认由proxy_host$request_uri 组成) | proxy_cache_key "$host$request_uri"; |

proxy_cache_valid |

为不同响应状态码设置缓存过期时间 | proxy_cache_valid 200 302 10m; proxy_cache_valid 404 1m; |

proxy_no_cache |

定义不缓存的请求条件 | proxy_no_cache $cookie_nocache $arg_nocache; |

proxy_cache_bypass |

定义绕过缓存、直接向后端请求的条件 | proxy_cache_bypass $cookie_nocache $arg_nocache; |

1.2 缓存工作流程

- 客户端请求到达 Nginx,根据

proxy_cache_key生成缓存键; - 检查缓存目录中是否存在对应的缓存文件且未过期;

- 若缓存有效且未命中旁路条件,直接返回缓存内容(缓存命中);

- 若缓存无效 / 不存在 / 命中旁路,Nginx 向后端服务器发起请求;

- 后端响应成功后,按配置规则缓存响应内容,再返回给客户端;

- 若后端响应失败,Nginx 可选择返回缓存的旧内容(缓存降级)或直接返回错误。

二、缓存命中失效的场景与处理策略

缓存命中失效是指 Nginx 未找到有效缓存,需向后端请求数据的场景。合理处理失效场景,既能保证数据一致性,又能避免缓存雪崩、穿透等问题。

2.1 常见缓存命中失效场景

- 缓存过期:缓存内容达到设置的 TTL(过期时间),Nginx 判定缓存失效;

- 缓存主动删除:业务数据更新后,需立即刷新缓存,手动触发缓存失效;

- 缓存清理:缓存目录达到最大容量,Nginx 按 LRU(最近最少使用)策略清理旧缓存;

- 请求参数变化:缓存键未正确包含请求参数,导致相同资源不同参数的请求误判为缓存命中;

- 后端响应状态码变化:如接口从 200 变为 500,缓存规则未适配导致失效后重新请求失败。

2.2 失效场景的优化处理方案

2.2.1 缓存过期的智能配置

缓存过期时间(TTL)并非固定值,需根据业务数据的更新频率动态配置。核心原则:数据更新越频繁,TTL 越短;数据越稳定,TTL 越长。

2.2.2 主动失效的实现方式

业务中常需在数据更新后立即刷新缓存,避免客户端获取旧数据。Nginx 提供两种主流实现方式:

- 通过 HTTP 响应头控制:后端更新数据后,返回

Cache-Control: no-store或Pragma: no-cache,强制 Nginx 不缓存本次响应,下次请求重新拉取新数据; - 通过缓存管理接口主动删除:使用

ngx_cache_purge模块(需额外编译安装),通过 HTTP 请求(如PURGE方法)手动删除指定缓存。

配置示例(ngx_cache_purge):

nginx

http {

# 加载purge模块(编译时需添加--with-http_cache_purge_module)

load_module modules/ngx_http_cache_purge_module.so;

proxy_cache_path /var/nginx/cache levels=1:2 keys_zone=my_cache:10m max_size=10g inactive=60m;

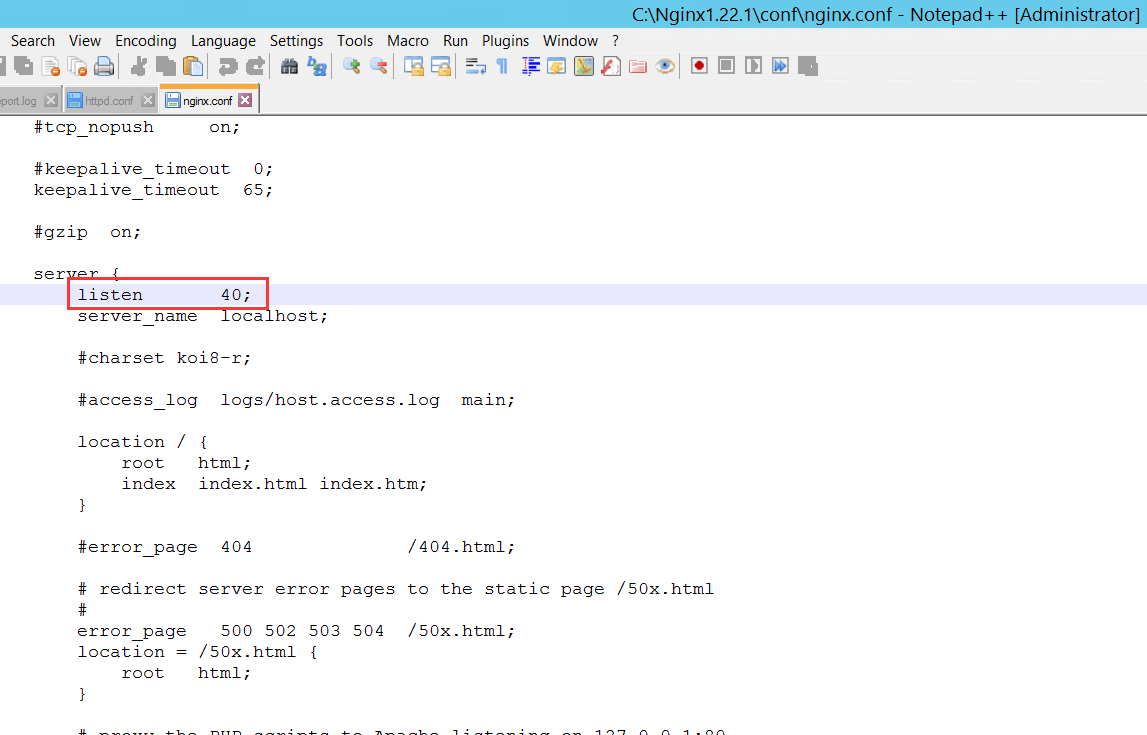

server {

listen 80;

server_name api.example.com;

# 开启缓存

proxy_cache my_cache;

proxy_cache_key "$host$request_uri";

proxy_cache_valid 200 302 10m;

# 配置purge缓存的接口

location ~ /purge(/.*) {

proxy_cache_purge my_cache "$host$1";

return 200 "Cache purged: $host$1";

}

# 反向代理后端服务

location / {

proxy_pass http://backend_server;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

}

}

}

使用方式:执行

curl -X PURGE http://api.example.com/purge/api/user/1,即可删除/api/user/1接口的缓存。2.2.3 避免缓存穿透与雪崩

- 缓存穿透:请求不存在的资源(如

/api/nonexist),缓存永远不会命中,请求直接打向后端,导致后端压力过大。解决:缓存 404 响应(

proxy_cache_valid 404 1m;),并设置极短的过期时间,减少无效请求。 - 缓存雪崩:大量缓存同时过期,导致瞬间大量请求打向后端,引发后端服务崩溃。

解决:

- 给 TTL 添加随机值(如

10m + random 5m),避免缓存集体过期; - 采用多级缓存(本地缓存 + 分布式缓存),降低 Nginx 缓存层的压力;

- 服务降级:后端服务异常时,Nginx 返回缓存的旧数据而非直接报错。

- 给 TTL 添加随机值(如

三、过期时间(TTL)的精准配置原则

过期时间是 Nginx 缓存的核心参数,配置不合理会导致 “缓存命中率低” 或 “数据不一致”。以下从业务场景出发,给出具体配置原则。

3.1 按资源类型配置 TTL

不同类型的资源,更新频率和业务容忍度差异极大,需分类配置:

表格

| 资源类型 | 示例 | TTL 配置策略 | 原因 |

|---|---|---|---|

| 静态资源(图片、CSS、JS) | /static/images/logo.png |

长 TTL(1h~7d) | 静态资源极少更新,可长期缓存,配合 CDN 效果更佳 |

| 动态接口(低频更新) | /api/article/list |

中 TTL(5m~30m) | 数据更新频率低,短时间缓存可显著降低后端压力 |

| 动态接口(高频更新) | /api/order/status |

短 TTL(10s~1m) | 数据实时性要求高,需缩短缓存过期时间 |

| 临时数据 | /api/verify/code |

极短 TTL(1m~5m) | 数据仅短期有效,过期后立即失效 |

3.2 按响应状态码配置 TTL

Nginx 的

proxy_cache_valid指令支持为不同状态码设置不同 TTL,合理配置可提升缓存利用率:nginx

# 200/302响应缓存10分钟,301永久缓存1天,404/500错误缓存1分钟

proxy_cache_valid 200 302 10m;

proxy_cache_valid 301 1d;

proxy_cache_valid 404 500 1m;

说明:错误状态码的缓存时间不宜过长,避免客户端长期获取到错误响应;同时可配合

proxy_next_upstream指令,后端异常时尝试其他节点。3.3 结合业务需求的动态 TTL 配置

若需根据业务场景动态调整 TTL,可通过

map模块或后端响应头控制:3.3.1 通过 map 模块动态配置

nginx

http {

# 定义map,根据请求路径匹配不同TTL

map $request_uri $cache_ttl {

default 10m;

~^/api/article 30m;

~^/api/order 1m;

~^/static 1h;

}

proxy_cache_path /var/nginx/cache levels=1:2 keys_zone=my_cache:10m max_size=10g;

server {

listen 80;

server_name api.example.com;

proxy_cache my_cache;

proxy_cache_key "$host$request_uri";

# 动态使用map中的TTL

proxy_cache_valid $cache_ttl;

}

}

3.3.2 通过后端响应头控制

后端服务在响应中返回

Cache-Control或Expires头,Nginx 直接使用该值作为缓存过期时间:nginx

# 优先使用后端响应的Cache-Control头,未指定则默认10分钟

proxy_cache_use_stale updating;

proxy_ignore_headers Cache-Control Expires;

proxy_set_header Cache-Control $upstream_http_cache_control;

proxy_cache_valid 10m;

3.4 缓存失效的兜底策略:inactive 与 max_size

proxy_cache_path中的两个关键参数需重点关注,它们决定缓存的实际失效逻辑:- inactive:缓存文件在指定时间内未被访问,则自动删除(默认不生效)。例如

inactive=60m,表示缓存文件 60 分钟未被访问,即使未到 TTL 也会被清理; - max_size:缓存目录的最大容量,达到容量后 Nginx 按 LRU 策略清理最久未使用的缓存文件。

配置建议:根据业务缓存文件数量和大小合理设置,避免

inactive过短导致缓存频繁失效,或max_size过小导致缓存被频繁清理。四、Nginx 缓存优化实战配置

结合以上理论,给出一套适用于通用 Web 服务的 Nginx 缓存优化配置,覆盖缓存开启、失效处理、TTL 配置、防穿透 / 雪崩等场景。

4.1 完整配置示例

nginx

user nginx;

worker_processes auto;

error_log /var/log/nginx/error.log warn;

pid /var/run/nginx.pid;

events {

worker_connections 10240;

use epoll;

multi_accept on;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

# 日志格式:记录缓存命中状态($upstream_cache_status)

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$upstream_cache_status"';

access_log /var/log/nginx/access.log main;

# 配置缓存路径:levels=1:2 表示缓存目录层级为1/2,提升检索效率;keys_zone分配10m内存存储缓存元数据(约存储8000个缓存键)

proxy_cache_path /var/nginx/cache

levels=1:2

keys_zone=web_cache:10m

max_size=20g

inactive=1h

use_temp_path=off; # 关闭临时文件路径,避免磁盘IO竞争

# 开启缓存共享:允许多个worker进程共享缓存

proxy_cache_lock on;

proxy_cache_lock_timeout 5s; # 缓存更新时,同一请求的并发锁超时时间

server {

listen 80;

server_name www.example.com api.example.com;

# 开启gzip压缩,提升缓存资源传输效率

gzip on;

gzip_types text/plain text/css application/javascript application/json;

gzip_min_length 1k;

# 静态资源缓存配置

location ~* \.(png|jpg|jpeg|gif|css|js|ico)$ {

proxy_cache web_cache;

proxy_cache_key "$host$request_uri";

proxy_cache_valid 7d; # 静态资源缓存7天

proxy_cache_use_stale error timeout invalid_header updating http_500 http_502 http_503 http_504; # 后端异常时使用缓存降级

proxy_headers_hash_max_size 512;

proxy_headers_hash_bucket_size 128;

proxy_pass http://backend_static; # 静态资源后端

expires 7d; # 客户端缓存7天

}

# 动态接口缓存配置

location /api/ {

proxy_cache web_cache;

proxy_cache_key "$host$request_uri$cookie_user"; # 包含用户标识,区分不同用户的缓存

proxy_cache_valid 200 302 10m; # 成功响应缓存10分钟

proxy_cache_valid 404 1m; # 404响应缓存1分钟,防穿透

proxy_cache_valid 500 502 503 504 10s; # 错误响应缓存10秒,快速恢复

proxy_no_cache $cookie_nocache $arg_nocache; # 携带nocache参数则不缓存

proxy_cache_bypass $cookie_nocache $arg_nocache; # 携带nocache参数则绕过缓存

proxy_cache_use_stale error timeout invalid_header updating http_500 http_502 http_503 http_504; # 缓存降级

proxy_pass http://backend_api; # 后端API服务

}

# 缓存主动清理接口(需配合ngx_cache_purge模块)

location ~ /purge(/.*) {

proxy_cache_purge web_cache "$host$1";

return 200 "Cache purged successfully: $host$1";

}

# 反向代理后端配置

upstream backend_static {

server 192.168.1.10:8080;

server 192.168.1.11:8080 backup;

}

upstream backend_api {

server 192.168.1.20:8080;

server 192.168.1.21:8080 backup;

}

}

}

4.2 关键优化点解析

- 缓存键优化:包含

$host和$request_uri,区分不同域名和请求路径;针对用户专属接口,添加$cookie_user或$arg_token,避免不同用户的缓存混淆; - 缓存降级:通过

proxy_cache_use_stale配置,后端服务异常时返回缓存的旧数据,保证服务可用性; - 防穿透:缓存 404/500 等错误响应,减少无效请求;

- 并发锁:

proxy_cache_lock避免缓存失效时的 “惊群效应”,大量并发请求同时请求后端; - 客户端缓存:结合

expires指令,设置客户端缓存头,减少重复请求; - 日志监控:通过

$upstream_cache_status记录缓存状态(HIT命中、MISS失效、BYPASS绕过、EXPIRED过期),便于监控缓存命中率。

五、缓存效果监控与调优

配置完成后,需通过监控和分析缓存指标,持续优化缓存策略。

5.1 核心监控指标

- 缓存命中率:

HIT请求数 / 总请求数,理想值应达到 80% 以上; - 缓存失效率:

MISS/EXPIRED请求数 / 总请求数,过高则说明 TTL 配置过短; - 缓存目录使用率:监控

/var/nginx/cache的磁盘使用率,避免达到max_size后频繁清理缓存; - 后端请求量:通过缓存命中率反向推导,命中率越高,后端请求量越低。

5.2 监控实现方式

- 日志分析:使用

awk统计access.log中$upstream_cache_status的分布:bash运行awk '{print $NF}' /var/log/nginx/access.log | sort | uniq -c - 监控工具:结合 Prometheus+Grafana,通过

nginx_status模块或自定义脚本采集缓存指标,可视化监控; - 业务指标:监控接口响应时间、后端服务 QPS,对比开启缓存前后的性能变化。

5.3 调优方向

- 缓存命中率低:优化缓存键、缩短 TTL(针对高频更新接口)、增加缓存容量;

- 数据不一致:缩短 TTL、优化主动失效逻辑、检查缓存